GitHubのAI支援機能「Copilot」がソフトウェア著作権侵害で訴えられる。これは人工知能にどう影響するのか?

「あなたのものは私のもの、私のものは私のもの」は、Microsoft、GitHub、OpenAIがAIを搭載したコーディングアシスタント「Copilot」を開発する際に指針とした原則だったようだ。

少なくとも、この3社に対する集団訴訟は、そのようなことを暗示している。

2021年6月にリリースされたCopilotは、GitHubによって、「リアルタイムでコードや関数全体を提案」できる「AIペアプログラマー」として宣伝されている。

自然言語のプロンプトを与えると、CoPilotはコードのブロックを使って回答します。

これは、OpenAIが開発し、Copilotに統合された別のAI製品、Codexのおかげです。

CopilotはGitHubのプログラマーが、月額10ドルまたは年額100ドルのサブスクリプション料と引き換えに利用することができる。

OpenAIは、一般にアクセス可能なGitHubリポジトリにあるコードでCopilotをトレーニングした。

マイクロソフトは、Copilotは「数十億行のコード」で訓練されたと言っているが、そのような宝の山にどうやって出くわしたかについては明確に触れていない。プログラマーで弁護士のMatthew Butterickが率いるこの訴訟によれば、問題はそこにある。

訴状では、このツールが、Microsoftが2018年にプラットフォームを買収した後に尊重することを約束したGitHubユーザーのオープンソースライセンスに違反していると主張しています。

すなわち、コピロートは著作権情報を表示しないか、その出力が派生物であることを何らかの形で示していないと訴え、「それによって前例のない規模のソフトウェアの違法コピーを達成している」と主張しています。

この訴訟では、コパイロットが「しばしば、オープンソースのリポジトリやオープンソースのライセンシーに遡ることができるコードを単に複製している」と主張している。

一方、OpenAI社は、Codexは「変形的公正利用」の定義を満たすため、ライセンス要件を免除されるべきだと主張している。

同社は、オープンソースコードは研究目的の」トレーニングデータとして使用され、「出力にそのまま」含まれることを意図したことはないと述べている。

さらに、Codexの出力の99%以上は「トレーニングデータと一致しない」と主張しています。

しかし、原告はまさにそれが起こっていると主張している。

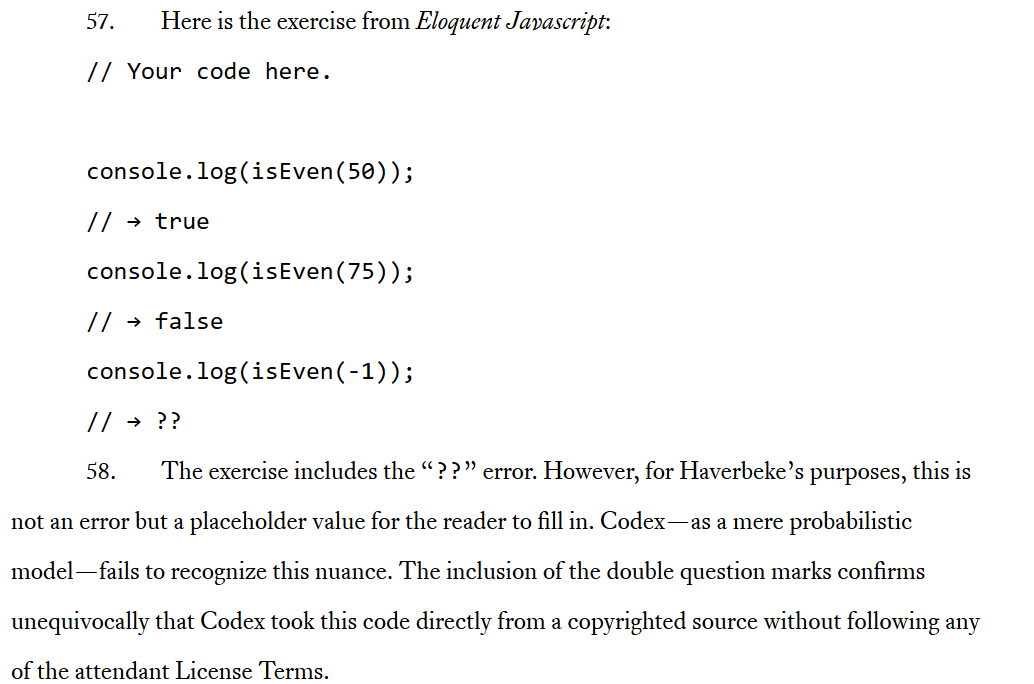

例として、訴状ではMarijn HaverbekeによるEloquent Javascript book に触れていますが、これはCreative Commons Attribution-Noncommercial licenseの下でライセンスされているものです。

この本の中のコードもまたMITライセンスの下でライセンスされています。

そのライセンスの条項では、Copilotは著作権表示と許可表示を含めることが要求されていますが、そうではありません。

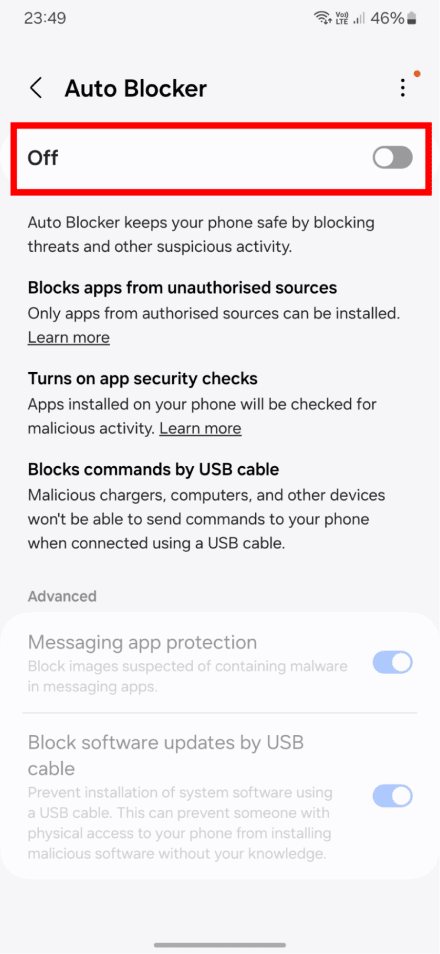

これは、Copilotがいかなるライセンス条項にも従うよう訓練されていないためであるby designと、この訴訟は述べている。そして、CodexがHaverbekeの本を含む著作権のあるソースから直接コードを効果的にコピーしていることを詳しく説明しています。

スクリーンショット: Codexが著作権のあるソースから"直接"コードをコピーしていると主張する詳細な訴訟からの抜粋です。

Copilotが構築された前提に疑問があると指摘しているのは、Butterick氏だけではありません。先月、開発者でテキサスA&Mのコンピューターサイエンス教授であるTim Davis氏もほとんど同じ結論に達している。Davisは、Copilotが彼の著作権で保護されたコードの*"大きな塊 "を帰属表示なしにパロっているとツイートしている。しかも、このAIを搭載したアシスタントは、コピーしているのがデイヴィスのコードだと認識しているようにさえ見えたという。研究者によると、Copilotに「Tim Davis風の」*コードを生成するよう促すと、彼のコードの*「少しいじった」*バージョンが得られたという。Copilotの発明者であるAlex Graveleyは、コードは「似ているが違う」ものだと主張し、類似性をごまかした。

盗作(他人の作品を、原作者への謝辞もなく自分のものとして発表すること)とインスピレーションの線引きをどこで行うかについては永遠の議論がありますが、今回の訴訟では、Copilotはむしろ前者に近いとされています。両社の保証とは裏腹に、「実際には......出力はしばしば学習データからほぼ同一のコードを複製したものである」*と、訴訟では訴えられている。

また、原告は、オープンソースのコードを使用して商用製品を構築することは、「フェアユース」を構成し、オープンソースのコミュニティに利益をもたらすというOpenAIの主張にも狙いを定めています。このような使用は、「公正でも、許可されても、正当化されてもいない」と訴え、Copilotが「オープンソースの大部分を取り上げてGitHubが管理する有料ウォールの中に置くことで置き換える」ようとしていると非難している。

Butterickは別のブログで、Copilotを「オープンソースの大規模なコーパスに対する便利な代替インターフェースに過ぎない」と説明している。しかし、Butterick氏によれば、この問題はもっと深刻だ。マイクロソフトは、オープンソースの作者と初心者プログラマーとの仲介役を務めることで、Copilotの利用者がオープンソースのコミュニティを発見する動機付けを*「一切」無くしている。長い目で見れば、オープンソースのコミュニティ全体に壊滅的な打撃を与え、代わりに「Copilotという壁のある庭」*に移動するような関与が奪われる可能性があると、Butterickは主張している。Copilotをオープンソースの貢献者から搾取する "寄生虫 "*と呼び、Microsoftの "GitHubが目指していたものすべてに対する裏切り "*を非難している。

コンセントは必要ない

Copilot論争を、Microsoftという一人の悪役のせいにしてしまいたくなることがある。この巨大テクノロジー企業はOpenAIと密接な関係にあり、同社に10億ドルを投資し、さらに投資しようとしている。ビッグテック全体として、利益のためにユーザーデータを搾取する習慣があると言えるが(メタやグーグルより先に行く必要はない)、AIシステムのトレーニングに関するルールや基準がないこともまた、救いようがない。

法的には、OpenAIやStability AI(テキストから画像を生成するStable Diffusionで最も有名)のような企業が、個人情報、著作権のあるコンテンツ、医療画像...

基本的にオンラインで投稿されたものでさえ、AIモデルを訓練することを止めるものは何もないのだ。

これらの生成AIモデルを学習させるデータセットは、インターネット上からかき集めたフィルターなしの大量のデータで構成されています。

あるAI製品を開発する企業は、不快なテキストや性的な画像を排除して、そのAIを洗練させることができる。しかし、AI企業には、それ以上のことをするインセンティブはほとんどない。

Have I Been Trainedのようなツールは、ユーザーが公開されているAIトレーニング教材の中から自分のデータを検索し、削除を要求できるようにするものだが、プライバシーやデータ保護という点では大海に一滴のようなものでしかない。

第一に、そこで見つけるのは簡単ではないし、第二に、削除されることを誰も保証していない。

さらに、データセットの中に自分のデータを見つけたということは、おそらくそれがすでにAIのトレーニングに使われ、何らかのAIを搭載した製品の一部になっている可能性があるということです。

つまり、実際には自分のデータがAI学習に使われることをオプトアウトできるのは、すでに船が出航した後だけなのです。

コパイロットの件は、AI学習の仕組みとその出力に初めて法廷で異議を唱えた人がいたようなので、画期的なことではあるが、かなり以前から批判は高まっていたようである。今年初め、英国のアーティスト組合が、"Stop AI stealing the show "というキャンペーンを立ち上げた。その中心的な要求のひとつは、政府がAIがアーティストのパフォーマンスを同意なしに複製することを違法とすることである。

このように、オプトアウトの仕組みの欠如と同意の問題が、AI議論の最前線に持ち込まれたのである。

問題は「何を」するかではなく、「どう」するか

バタリックが書いているように、プログラマー(コパイロットのケース)であれビジュアルアーティストであれ、クリエイターの主な異議申し立ては、AI技術一般に対してではなく、これらのツールを作成した企業が彼らに行動を要求する方法に対してである。

「例えば、参加は任意であるとか、コーダーが訓練コーパスに貢献するために報酬を受けるとか」と書いている。

ゲッティ イメージズのようにAIが生成したアートを全面的に禁止しているプラットフォームもあれば、バタリックが概説した方向に進もうとしているプラットフォームもある。

例えば、最近OpenAIやLGとの提携の一環としてAI生成コンテンツの販売を開始したShutterstockは、投稿者のアカウントにオプトアウト機能を追加すると発表しています。

その機能は、「アーティストが、自分のコンテンツがコンピュータ・ビジョン技術のトレーニングに使われることを望まない場合、将来のあらゆるデータセットから自分のコンテンツを除外することを可能にする」それに加えて、シャッターストックは、AI生成モデルの開発にIPが使われたアーティストに補償するために使われるであろう、貢献者ファンドを設立しました。

DeviantArtも同様に、AIシステムによるコンテンツのかき集めをブロックする方法をクリエイターに提供しています。

自分の作品をAI学習から除外するよう要請したDevianArtのアーティストのページには、特別なHTMLタグが適用されることになる。サードパーティは、プラットフォームの利用規約に基づいて、このタグが付いたコンテンツをフィルタリングしなければならない。

技術的には、AIシステムはまだそのデータを吸い上げることができるだろう、ということは注目に値する。

しかし、このような好意的な例はほとんどなく、適切な規制がない限り、それが標準になることはないだろう。コパイロットの訴訟は、AIトレーニングの問題に光を当てるだけでなく、その必要なシフトの引き金になるかもしれません。

新しいAI製品がキノコのように出てくるのを見ると、手遅れになる前に、そしてすでに私たちのデータを食い尽くしてしまう前に、その背後にいる企業を抑制する必要があるのです。

問題をさらに深刻にしているのは、プライバシーやユーザーデータの保護を軽視していることで悪名高いビッグテック企業が、AI革命をリードしているという事実です。

グーグルは、コードネームPitchforkを含むいくつかのAIコードプロジェクトに取り組んでいると報告されている。

現在まだ開発中のこの秘密ツールでは、AIが自らコードを書き、修正すると伝えられている。このプロジェクトの背後にあるアイデアは、グーグルのプログラミング言語Pythonのコードベースの更新を効率化することだった。すなわち、ソフトウェアエンジニアを排除し、AIに仕事をさせることだ。グーグルの情報筋に話を聞いたBusiness Insiderによると、プロジェクトの目的はその後、このツールをより*"汎用的なシステム "*にするためにシフトしたという。

新しい技術にもデータ悪用の古いクセ

Copilotに挑戦したGitHubのプログラマーたちの試みから何が生まれるのか、そして業界全体に波及効果があるのかどうかはまだわからない。

一方で、AI問題が浮上したのは、生成型AIシステムを支える技術が新しく、公正使用と著作権侵害の間のグレーゾーンで蛇行しているためです。

一方で、この問題は古くから存在するものでもあります。その核心は、ユーザーデータを自分のものとして扱うテック企業による誤操作にある。この難問のAI特有の部分を、何らかの規則や規制を構想することで解決しようとすることはできますが、EUや米国がビッグテックから個人データを守ろうとする試みから分かるように、最も厳しい法律でさえも万能ではありません。

ビッグテックは、プライバシー規則やデータ保護法を回避するための抜け道や回避策を常に探しています。しかし、だからといって、私たちコミュニティは、政府に対してこれらの規則を策定するよう、またハイテク企業に対してそれらを遵守するよう圧力をかけてはならないのです。